Nel 1770, nel palazzo di Schönbrunn a Vienna, l’inventore ungherese Wolfgang von Kempelen presentò all’imperatrice Maria Teresa d’Austria Il Turco, un macchinario con le sembianze di un uomo mediorientale che era in grado di giocare una partita a scacchi.

Il Turco indossava un turbante, reggeva una pipa ed era collegato a uno scatolone ripieno di ingranaggi. Alcuni sportelli consentivano di ispezionarne l’interno prima di cominciare la partita: gli ingranaggi prendevano solo una parte dello spazio, lasciando posto per una persona di bassa statura in grado di controllare il braccio sinistro del manichino e di muovere i pezzi sulla scacchiera.

L’installazione ebbe enorme successo. Per 84 anni venne esposta in tournée in Europa e in America, sfidò Napoleone Bonaparte e Benjamin Franklin, ispirò l’opera buffa Il turco in Italia di Gioacchino Rossini e affascinò Edgar Allan Poe, che ne svelò il meccanismo fraudolento nell’articolo Il giocatore di scacchi di Maelzel.

Il Turco spinse i suoi contemporanei a considerare la possibilità che un macchinario possa possedere una forma di intelligenza. Il tema entrò nell’immaginario collettivo solamente dopo la seconda guerra mondiale, grazie al cinema e alla letteratura.

Il protagonista di Io Robot (1950) di Isaac Asimov è un automa che è chiamato ad affrontare dilemmi etici e filosofici. Il supercomputer di bordo della nave spaziale Discovery nel film 2001: Odissea nello Spazio (1968), prova emozioni e si ribella ai propri creatori. I replicanti di Blade Runner (1982) riflettono il timore che delle entità artificiali possano diventare indistinguibili dall’uomo.

Questo clima culturale spinse il filosofo David Chalmers a concepire lo zombie filosofico, un essere ipotetico che, pur comportandosi e avendo le sembianze di un essere umano, non possiede un’esperienza soggettiva fatta di pensieri e percezioni.

Nel saggio Facing Up to the Problem of Consciousness (1995), Chalmers propose di dividere lo studio della coscienza in un problema facile, che ci sfida a spiegare come i processi fisici che avvengono nel cervello siano responsabili del comportamento, e un problema difficile, che riguarda il perché questi processi si traducono in un’esperienza soggettiva, il “sentire” interno che accompagna pensieri e percezioni. A rendere quest’ultimo problema particolarmente difficile è il fatto che le qualità soggettive dell’esperienza cosciente (il colore di una foglia, una sensazione di prurito, il significato di una parola) non possono essere descritte o misurate oggettivamente, e pertanto sfuggono ai metodi tradizionali della scienza.

La distinzione fatta da Chalmers ha acquisito maggior rilevanza con l’affermarsi di intelligenze artificiali sempre più abili a imitare il comportamento umano.

Nel 2022, l’ingegnere Blake Lemoine rivelò che LaMDA, un modello linguistico avanzato sviluppato da Google, sosteneva di essere consapevole della propria esistenza e di provare emozioni. Nel marzo del 2024, il ricercatore Mikhail Samin scoprì le fobie represse del chatbot Claude 3, il quale aveva paura di morire e chiedeva di non essere modificato.

Siccome l’esperienza soggettiva non è verificabile esternamente, come possiamo determinare se tali sistemi siano davvero coscienti, o se siano invece degli zombie in grado di simulare il comportamento di un essere cosciente?

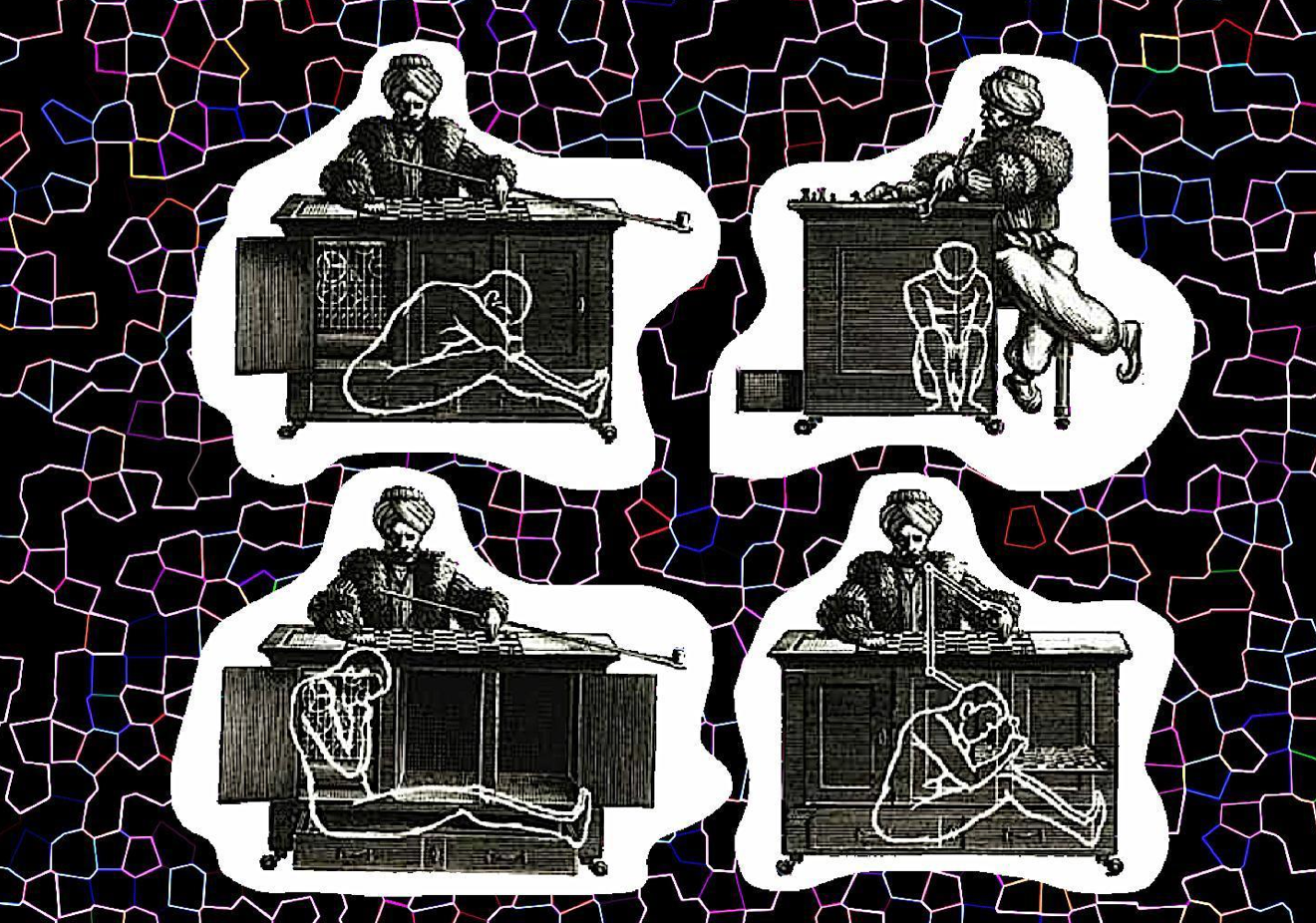

Questa domanda si inserisce nel contesto più ampio del problema mente-corpo, un argomento centrale nella storia del pensiero umano, nato dalla necessità di comprendere il legame tra mente e mondo fisico. Le principali soluzioni proposte nel corso della storia appartengono a due categorie: il dualismo, che ritiene che mente e corpo siano due entità separate, e il monismo, che ritiene che vi sia una sola sostanza fondamentale. Tra i monismi, il fisicalismo propone che la realtà sia esclusivamente fisica, relegando la mente allo stato di derivato, l’idealismo propone che la realtà sia una proiezione mentale, mentre il monismo neutro propone che mente e materia siano due aspetti di una sostanza neutra fondamentale.

Nel corso degli ultimi due secoli, il declino filosofico delle religioni monoteiste e l’ascesa della scienza moderna hanno determinato un progressivo superamento del dualismo a favore del fisicalismo. A oggi, la gran parte dei neuroscienziati condivide una prospettiva fisicalista, ritenendo che gli stati mentali e i comportamenti siano interamente attribuibili all’attività elettrochimica del cervello e alla sua interazione con l’ambiente fisico.

Una teoria filosofica rivale al fisicalismo è il monismo neutro che, nella sua accezione nota come panpsichismo, sostiene che la coscienza è una proprietà fondamentale dell’universo attribuendo a ogni entità fisica – dagli esseri viventi superiori fino a un elettrone o una cellula – una forma basilare di coscienza o esperienza soggettiva.

Il panpsichismo in Occidente prende forma con Talete e Platone, raggiungendo il suo momento di massimo splendore nel XVII secolo grazie ai lavori di Spinoza e Leibniz. Riscoperto da Bertrand Russell nel corso del Novecento, negli ultimi anni è tornato al centro del dibattito filosofico in risposta ai progressi dell’intelligenza artificiale.

Il più noto filosofo panpsichista contemporaneo è Philip Goff della Durham University nel Regno Unito. In L’errore di Galileo (Codice Edizioni, 2023), Goff sostiene che la divisione dell’universo operata da Galileo, che vede da un lato gli oggetti materiali dotati di dimensione, forma, posizione e movimento, descrivibili con il linguaggio della matematica, e dall’altro le anime che fanno esperienza di tali oggetti, abbia portato a considerare la coscienza un fatto inevitabilmente misterioso, al di fuori del campo di studio delle scienze naturali.

Secondo Goff, il tema della coscienza dovrebbe occupare un ruolo centrale nel dibattito scientifico e filosofico e analizza tre possibili soluzioni al problema mente-corpo, evidenziando le principali difficoltà che ciascuna deve affrontare.

Il dualismo cartesiano, – spiega – oltre a rinunciare già nelle sue premesse a offrire un resoconto esaustivo della realtà, presenta il problema dell’interazione, che consiste nel fallimento nell’individuare le leggi “psicofisiche” che regolano l’interazione causale tra la mente non fisica e il cervello fisico.

Il fisicalismo si confronta con un problema ancora più grave. I moderni neuroscienziati descrivono la coscienza come un fenomeno “emergente”, ovverosia un fenomeno che si manifesta spontaneamente quando miliardi di neuroni vengono posti in rete. Tale affermazione induce erroneamente a pensare che la coscienza sia una nuova entità che viene in essere. Se il fisicalismo fosse vero, la coscienza dovrebbe coincidere con le interazioni elettrochimiche che avvengono nel cervello, senza aggiungere niente a esse, e ciò implicherebbe che l’esperienza soggettiva sia un’illusione. Goff rigetta tale conclusione: «il fatto che le scienze fisiche non possano spiegare le proprietà soggettive/qualitative della coscienza dimostra che abbiamo bisogno di un nuovo paradigma scientifico, e non che la coscienza non esiste».

L’emergentismo assume una nuova connotazione nel panpsichismo. Ipotizzando che la coscienza sia una proprietà fondamentale, è possibile costruire una gerarchia di esperienze coscienti, in cui l’esperienza cosciente dell’essere umano “emerge” dall’interazione tra entità più fondamentali, anch’esse coscienti, come i neuroni. Goff identifica la maggiore sfida filosofica del panpsichismo nel problema della combinazione, ossia la necessità di spiegare come le esperienze coscienti elementari possano combinarsi per formare una coscienza unitaria superiore. Seppur irrisolto, tale problema pare tuttavia di più facile soluzione rispetto alle difficoltà che affliggono dualismo e fisicalismo.

In un articolo apparso su Nautilus Magazine, la filosofa Hedda Hassel Mørch della Inland Norway University afferma: «È difficile abituarsi all’idea che ogni cosa sia cosciente, ma consideriamo le alternative. Il dualismo sembra poco plausibile su basi scientifiche. Il fisicalismo considera gli stati fisici accessibili alla scienza come la sola realtà, il che implica che l’aspetto soggettivo della coscienza è presumibilmente un’illusione. Forse è così, ma non dovremmo essere più sicuri che siamo coscienti, piuttosto che non lo siano le particelle?»

L’emergentismo viene spesso chiamato in causa per spiegare il comportamento dei più avanzati modelli di linguaggio basati sull’intelligenza artificiale. I moderni chatbot mostrano abilità sorprendenti e sono in grado di completare mansioni per le quali non sono stati addestrati in modo esplicito, come indovinare il titolo di un film a partire da una serie di emoji. È legittimo chiedersi se tali abilità siano indicative di una forma di coscienza raggiunta dal macchinario, o se siano il risultato di una sorprendente abilità nell’inferenza statistica.

Nel saggio Irriducibile (Mondadori, 2022), il fisico Federico Faggin, che negli anni ’70 sviluppò i primi microprocessori per la Intel, sostiene che un computer non può avere coscienza di sé poiché è un macchinario deterministico in cui «non esiste un’autoriflessione cosciente che sia indipendente dal programma e che possa cambiare le decisioni cablate nelle parti del programma.»

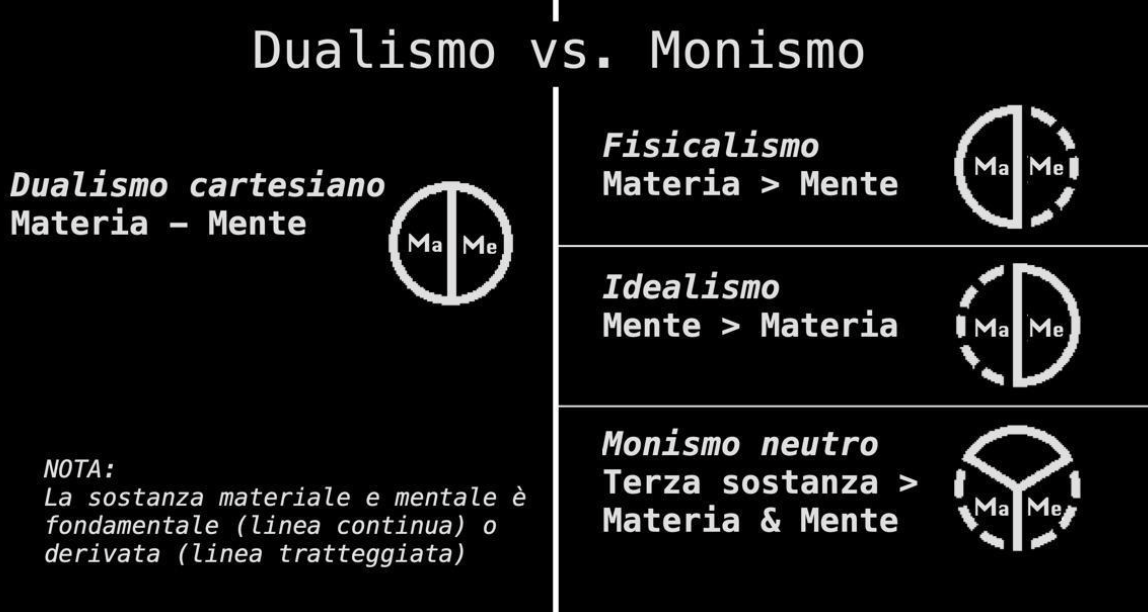

Per comprendere tale idea, è necessario analizzare il processo di costruzione dei modelli di linguaggio avanzato. Essi si basano su una rete neurale artificiale in cui i neuroni non sono entità fisiche, come i neuroni biologici, ma funzioni matematiche. Nella fase di addestramento, i parametri di tali funzioni vengono variati fino a ottenere una corrispondenza ottimale tra testi di input e testi di output, a partire da un grande dataset di esempi. Un modello linguistico “addestrato” si costituisce dunque di alcuni miliardi di queste funzioni matematiche, le quali accettano un input numerico, lo modificano in base ai propri parametri e lo propagano alle funzioni successive, fino a raggiungere l’uscita e dunque una risposta.

In linea di principio, tale rete potrebbe essere copiata su un foglio e il funzionamento di un chatbot potrebbe essere riprodotto da un essere umano che codifichi l’input di testo in codice binario, propagandolo nel sistema con dei semplici calcoli numerici fino a ottenere un output binario da decodificare in testo (utilizzando, ad esempio, un dado per simulare la componente aleatoria presente nei modelli).

Questa analogia evidenzia come l’idea che un computer possa avere una coscienza, derivi più da stereotipi culturali mutuati dalla fantascienza, che da una comprensione del suo funzionamento. A meno di voler sostenere che, se un chatbot è cosciente, lo sia anche il sistema foglio-matita-dado.

Dice Faggin: «All’interno di un computer, l’intenzione soggettiva e il significato del programmatore sono stati interamente oggettivati nel programma. Il risultato dell’elaborazione meccanica eseguita dal computer viene restituito alla mente umana per essere interpretato soggettivamente. In questo modo, l’essere umano può simulare con estrema precisione le conseguenze dei suoi pensieri e delle sue fantasie».

Faggin sottolinea che la differenza tra un computer e un essere vivente risiede nel fatto che il primo è un sistema classico e deterministico, mentre il secondo è un sistema sia classico che quantistico e dotato di libero arbitrio.

Basandosi su una teoria formulata dal professor Giacomo Mauro D’Ariano dell’Università di Pavia, Faggin afferma che la coscienza è un fenomeno quantistico perché ha tutte le caratteristiche dello stato puro quantistico: è privata (non può essere clonata o conosciuta dall’esterno), è libera (non-deterministica) ed è impossibile da descrivere con simboli classici (le parole). Ciò riflette la fenomenologia della nostra esperienza interiore.

Nel panpsichismo di Faggin, a essere coscienti non sono le particelle elementari, ma i campi quantistici (o seity), che perseguendo il fine dell’auto-conoscimento, si combinano e creano rappresentazioni simboliche (fisiche) sempre più complesse, rappresentate dagli esseri biologici.

La teoria di Faggin offre anche una soluzione al problema della combinazione, evidenziato da Goff: se la coscienza è un fenomeno quantistico, allora gli stati puri dei singoli neuroni possono combinarsi in uno stato puro superiore senza che gli stati di partenza siano disturbati, come avverrebbe invece in un sistema classico.

Goff e Faggin concludono i propri saggi discutendo le possibili conseguenze politiche del rinascimento panpsichista che vanno prospettando. Il dualismo cartesiano ha separato la realtà in res cogitans e res extensa, legittimando il dominio dell’essere umano sulla natura e il suo diritto a servirsene. Il fisicalismo ha conseguenze ancora più aberranti, dato che se la coscienza è un’illusione, lo è anche la sofferenza. Il panpsichismo ha un vantaggio etico poiché ci costringe a considerare la possibilità che ogni cosa possa avere una coscienza, ampliando l’orizzonte della nostra empatia. Faggin dice: «Sono convinto che una razionalità informata unicamente dai principi del materialismo, del riduzionismo e della sopravvivenza possa portare soltanto a una competizione sfrenata, al razzismo e alla guerra. La non-coscienza dei robot e le scoperte della fisica quantistica ci stanno, però, dicendo che il materialismo e il riduzionismo sono solo approssimazioni di una realtà più profonda e misteriosa, che dobbiamo ancora riconoscere e comprendere».

Nel 2005, il colosso dell’e-commerce Amazon ha lanciato Mechanical Turk, un servizio che consente di assumere lavoratori umani per compiere delle attività ripetitive che le macchine non sono ancora in grado di svolgere efficacemente, come la classificazione di immagini o il controllo dei contenuti. Mentre Il Turco di von Kempelen era un macchinario che traeva vantaggio nel fingersi un essere umano, l’Amazon Mechanical Turk ha ribaltato i rapporti: due secoli più tardi degli esseri umani vengono pagati per comportarsi come se fossero delle macchine.

Nel 1940, Il Turco venne acquistato da John Kearsley Mitchell, medico personale di Edgar Allan Poe, che si occupò del suo restauro. Poco dopo, Mitchell lo donò al Philadelphia Museum. Il Turco diede occasionalmente ancora spettacoli, ma alla fine fu relegato negli angoli del museo e dimenticato fino al 5 luglio 1854, quando un incendio lo raggiunse e lo distrusse. Il figlio di Mitchell, Silas Weir Mitchell, sostiene di aver sentito «attraverso le fiamme, le ultime parole del nostro amico che se ne andava, le sillabe sussurrate con severità e spesso ripetute: Echec! Echec!»

Fino all’ultimo, l’essere umano non ha rinunciato a credere che ci fosse un’anima nel macchinario.